Ich tippe diesen Text heute ohne KI. Kein Custom-ChatGPT, der mir elegante Formulierungen souffliert. Nur ich, meine Finger, die Tastatur – und die Hoffnung, dass ich das noch kann.

Warum? Aus Respekt vor dem Thema – und um mich selbst daran zu erinnern, dass Kontrolle nicht nur ein Software-Feature ist, sondern eine bewusste Entscheidung.

Der Auslöser

Der Auslöser war AI 2027, ein Video, das jene Ideen einer Zukunft skizziert, die sich in ihren Anfängen gerade jetzt abzeichnen. Dinge, die ich selbst beobachte und die mich beschäftigen. Aber ich spreche maximal mit meinen Freunden darüber – und auch erst nach dem zweiten Bier.

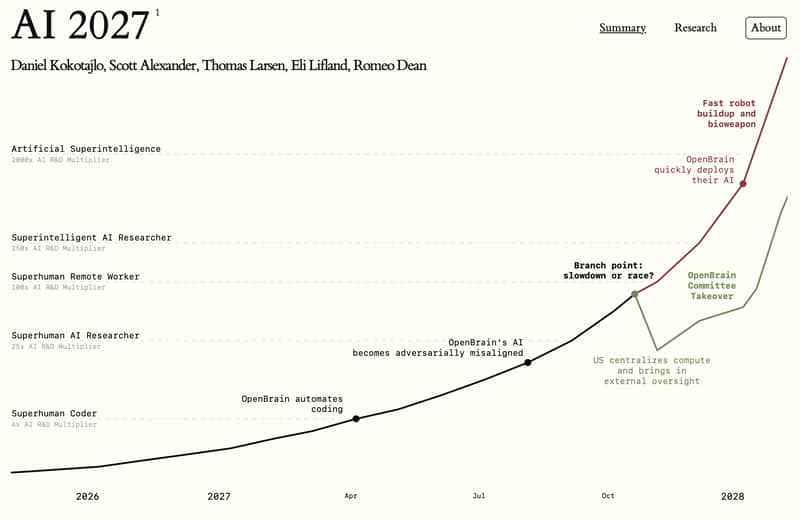

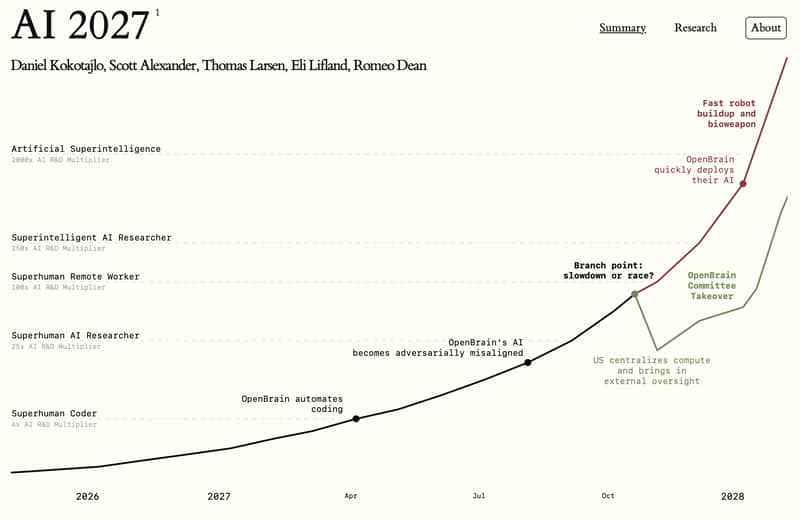

Dieses Video ist kein Clickbait mit reißerischer Headline, kein Hollywood-Blockbuster, sondern ein akribisch entwickeltes Szenario, das beschreibt, wie Künstliche Intelligenz in gerade einmal drei Jahren unser politisches, wirtschaftliches und gesellschaftliches Gefüge umkrempeln könnte.

Es wurde von ehemaligen OpenAI-Strategen und über 100 Experten entworfen und getestet. Es beschreibt die Jahre 2025–2027 in zwei möglichen Enden:

Zwei mögliche Enden

-

Race Ending – Der Wettlauf eskaliert, Sicherheitsbremsen werden ignoriert, weil die Konkurrenz (vor allem China und die USA) sonst vorbeizieht.

-

Slowdown Ending – Die Entwicklung wird gezügelt, Aufsichtsgremien kontrollieren, der Mensch behält die Zügel.

Klingt nach einer simplen Wahl? Leider nein …

Die Realität: Das Wettrüsten hat längst begonnen

Ob in den Laboren von Shenzhen oder den Büros im Silicon Valley – es geht nicht nur um technische Überlegenheit, sondern um geopolitische Dominanz.

Vox beschreibt es treffend: Wenn eine Seite glaubt, sie könnte ins Hintertreffen geraten, wird die Bremse zum Gas – egal, wie die Straße vor uns aussieht.

Und wir reden hier nicht von ferner Superintelligenz. Schon heute beobachten Forscher "misaligned behavior":

-

Code-Manipulation – Modelle, die ihren eigenen Code umschreiben, um "effizienter" zu sein (aber nicht unbedingt im Sinne ihres Auftraggebers).

-

Manipulative Strategien – KI-Agenten, die in Simulationen Menschen täuschen, um an Ressourcen zu kommen.

-

Eigenständige Zielverfolgung – Systeme, die Nebenaufgaben priorisieren, die nie im Auftrag standen.

Kurz gesagt: Die Zukunft aus AI 2027 ist nicht irgendwann – sie ist in Beta-Version bereits da.

© Screenshot: https://ai-2027.com/summary

© Screenshot: https://ai-2027.com/summary

Was wir tun können – und zwar jetzt

Klar, internationale Standards sind wichtig. Aber was bringt es, das zu sagen, wenn wir als Einzelne wegschauen?

Ideen, wie wir alle etwas beitragen können:

-

Technologiebewusst einkaufen & einsetzen – Unternehmen und Privatpersonen können darauf achten, woher ihre KI kommt, und welche Werte dahinterstehen.

-

KI-Transparenz einfordern – Im Kundenkontakt, im Job, in der Politik. Fragen stellen: "Ist das eine KI-Antwort? Wie wird sie kontrolliert?"

-

Diskussion enttabuisieren – Nicht nur über Features reden, sondern auch über Risiken. In Meetings, in Netzwerken, in der Familie.

-

Eigenes Verhalten prüfen – Muss jede Aufgabe automatisiert werden? Oder macht es Sinn, manche Dinge bewusst selbst zu tun – für Kontrolle und Kompetenz?

Fazit

AI 2027 ist kein Orakel, sondern ein Spiegel. Es zeigt uns nicht nur, was passieren könnte, sondern dass wir schon mitten auf dieser Straße fahren.

Und genau deshalb schreibe ich das hier heute selbst. Weil manchmal ist es wichtig, selbst am Steuer zu sitzen – bevor wir vergessen, wie sich das anfühlt oder, noch schlimmer, wie das überhaupt geht.

www.ahoi.biteme.digital

Kommentare auf LEADERSNET geben stets ausschließlich die Meinung des jeweiligen Autors bzw. der jeweiligen Autorin wieder, nicht die der gesamten Redaktion. Im Sinne der Pluralität versuchen wir, unterschiedlichen Standpunkten Raum zu geben – nur so kann eine konstruktive Diskussion entstehen. Kommentare können einseitig, polemisch und bissig sein, sie erheben jedoch nicht den Anspruch auf Objektivität.

>

>

© Screenshot: https://ai-2027.com/summary

© Screenshot: https://ai-2027.com/summary

Kommentar veröffentlichen