Fotos und Video vom IFA 2026

Spitzenvertreter der Versicherungswirtschaft tagten in Stegersbach

Beim 14. Insurance Forum Austria standen geopolitische Unsicherheiten, der rasante Fortschritt der Künstlichen Intelligenz sowie zunehmende Klimarisiken im Fokus. LEADERSNET.tv hat mit dem Initiator und den Branchenvertreter:innen darüber gesprochen, warum sich die Veranstaltung als Fixpunkt etabliert hat, weshalb der Austausch gerade jetzt essenziell ist und mit welchen zentralen Herausforderungen die Branche im Jahr 2026 konfrontiert ist.

Entwurf zum EABG präsentiert

So reagiert die Wirtschaft auf den "Turbo für die Energiewende"

Am Donnerstag wurde der Entwurf zum Erneuerbaren-Ausbau-Beschleunigungsgesetz präsentiert. Die Regierung verspricht ein "One-Stop-Shop"-Prinzip und mehr Unabhängigkeit von Energieimporten. Von Wirtschafts- und Branchenvertreter:innen gibt es Lob und Kritik.

Fotos und Video von der Jubiläumsfeier

Beim Hotel Sacher Wien ist nach 150 Jahren plötzlich "der Wurm drinnen"

Mit einer Kunstinstallation und prominenten Gästen hat die "Ikone der Gastfreundschaft" ihr Jubiläumsjahr eingeläutet. Zum Auftakt des Festjahres wurden Skulpturen eines bekannten Künstlers enthüllt. LEADERSNET.tv holte die Geschäftsführer:innen, den Bürgermeister und VIPs vor die Kamera.

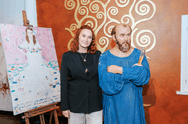

Fotos vom Event

VIP-Auflauf bei Baumanns Charity Kalender Präsentation

Auch in diesem Jahr unterstützt der Starfotograf die karitative Initiative Dancer against Cancer mit einem Kalender. Das heurige Motto "Tears of Strength" soll jenen Betroffenen Sichtbarkeit verleihen, die ihre Belastung oft still tragen.

>

>

Kommentar veröffentlichen